要使开发人员能够在 TKG 集群上部署 AI/ML 工作负载,vSphere 管理员应设置 主管 环境以支持 NVIDIA GPU 硬件。

管理员步骤 1:查看系统要求

| 要求 | 描述 |

|---|---|

| vSphere 8 基础架构 |

vCenter Server 和 ESXi 主机 |

| 工作负载管理许可证 |

vSphere 命名空间和 主管 |

| TKR Ubuntu OVA | |

| NVIDIA vGPU 主机驱动程序 |

|

| 用于 vGPU 的 NVIDIA 许可证服务器 |

您的组织提供的 FQDN |

管理员步骤 2:在 ESXi 主机上安装受支持的 NVIDIA GPU 设备

要在 TKG 上部署 AI/ML 工作负载,应在要启用工作负载管理的 vCenter 集群中的每个 ESXi 主机上安装一个或多个受支持的 NVIDIA GPU 设备。

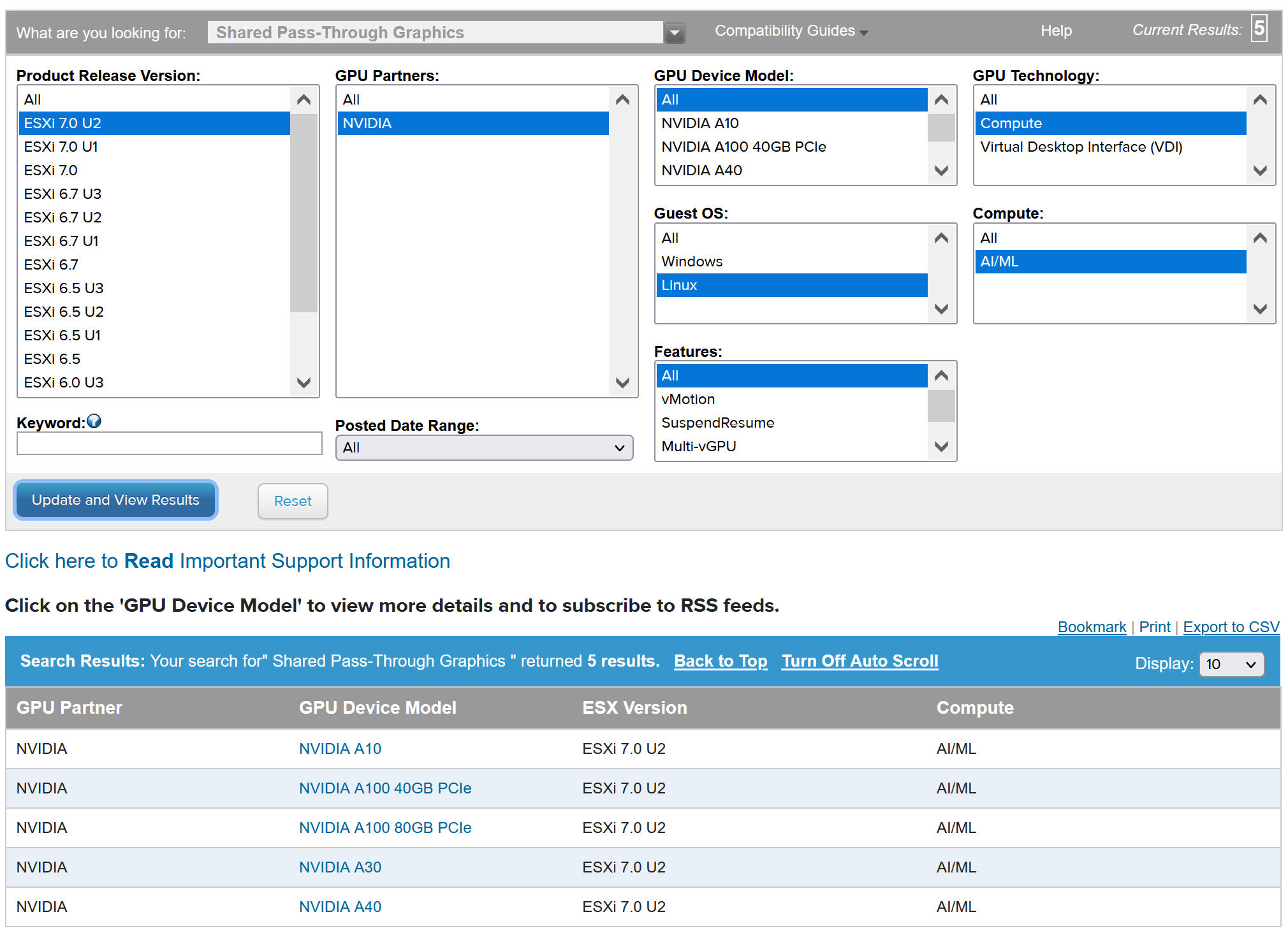

要查看兼容的 NVIDIA GPU 设备,请参阅 VMware 兼容性指南。

NVIDA GPU 设备应支持最新的 NVIDIA AI Enterprise (NVAIE) vGPU 配置文件。有关指导,请参阅 NVIDIA 虚拟 GPU 软件支持的 GPU 文档。

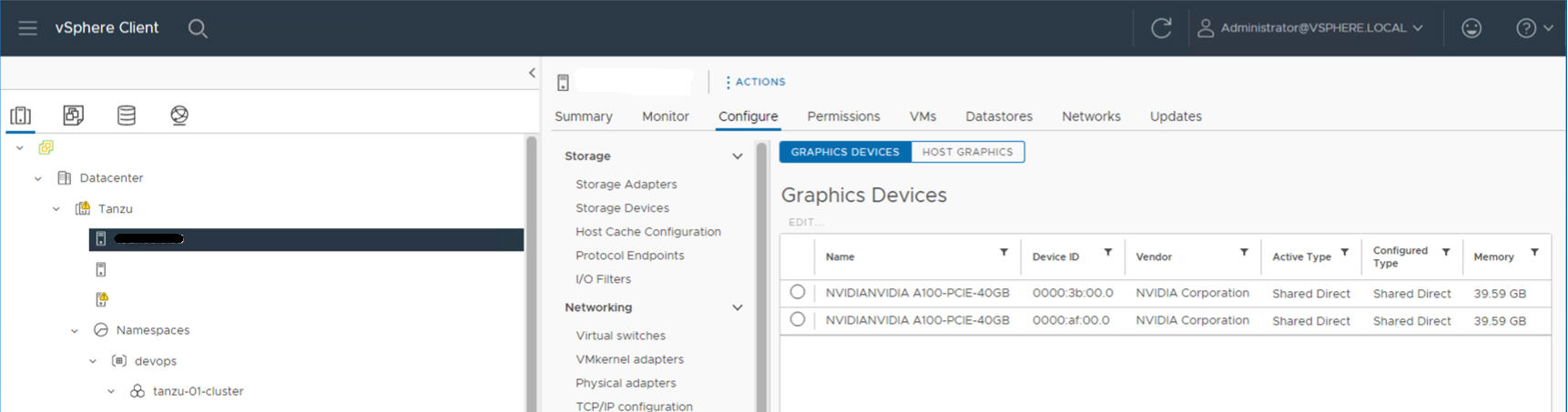

例如,以下 ESXi 主机上安装了两个 NVIDIA GPU A100 设备。

管理员步骤 3:针对 vGPU 操作配置每个 ESXi 主机

对于启用了工作负载管理的 vCenter 集群中的每个 ESXi 主机,请通过启用直接共享和 SR-IOV 为 NVIDIA vGPU 配置主机。

在每个 ESXi 主机上启用直接共享

要解锁 NVIDIA vGPU 功能,请在启用了工作负载管理的 vCenter 集群中的每个 ESXi 主机上启用直接共享模式。

- 使用 vSphere Client 登录 vCenter Server。

- 选择 vCenter 集群中的 ESXi 主机。

- 选择。

- 选择 NVIDIA GPU 加速器设备。

- 编辑图形设备设置。

- 选择直接共享。

- 对于共享直通 GPU 分配策略,为获得最佳性能,请选择将虚拟机分散在多个 GPU 中

- 单击确定保存配置。

- 请注意,这些设置将在重新启动主机后生效。

- 右键单击 ESXi 主机,然后将其置于维护模式。

- 重新引导主机。

- 当主机再次运行时,将其退出维护模式。

- 对支持工作负载管理的 vSphere 集群中的每个 ESXi 主机重复此过程。

为 NVIDIA GPU A30 和 A100 设备启用 SR-IOV BIOS

如果使用多实例 GPU(MIG 模式)所需的 NVIDIA A30 或 A100 GPU 设备,则必须在 ESXi 主机上启用 SR-IOV。如果未启用 SR-IOV,Tanzu Kubernetes 集群节点虚拟机将无法启动。如果发生这种情况,您会在启用了工作负载管理的 vCenter Server 的近期任务窗格中看到以下错误消息。

Could not initialize plugin libnvidia-vgx.so for vGPU nvidia_aXXX-xx. Failed to start the virtual machine. Module DevicePowerOn power on failed.

要启用 SR-IOV,请使用 Web 控制台登录到 ESXi 主机。选择。选择 NVIDIA GPU 设备,然后单击配置 SR-IOV。您可以从此处启用 SR-IOV。有关其他指导,请参见 vSphere 文档中的单根 I/O 虚拟化 (SR-IOV)。

vGPU 和动态 DirectPath IO(启用了直通的设备)

- 使用 vSphere Client 登录 vCenter Server。

- 选择 vCenter 集群中的目标 ESXi 主机。

- 选择。

- 选择所有 PCI 设备选项卡。

- 选择目标 NVIDIA GPU 加速器设备。

- 单击切换直通。

- 右键单击 ESXi 主机,然后将其置于维护模式。

- 重新引导主机。

- 当主机再次运行时,将其退出维护模式。

管理员步骤 4:在每个 ESXi 主机上安装 NVIDIA 主机管理器驱动程序

要运行具有 NVIDIA vGPU 图形加速的 Tanzu Kubernetes 集群节点虚拟机,请在将启用工作负载管理的 vCenter 集群中的每个 ESXi 主机上安装 NVIDIA 主机管理器驱动程序。

NVIDIA vGPU 主机管理器驱动程序组件打包在 vSphere 安装包 (VIB) 中。NVAIE VIB 由您的组织通过其 NVIDIA GRID 许可计划提供给您。VMware 既不提供 NVAIE VIB,也不提供它们的下载服务。根据 NVIDIA 许可计划,许可服务器由您的组织设置。有关详细信息,请参阅 NVIDIA 虚拟 GPU 软件快速入门指南。

esxcli system maintenanceMode set --enable true esxcli software vib install -v ftp://server.domain.example.com/nvidia/signed/NVIDIA_bootbank_NVIDIA-VMware_ESXi_7.0_Host_Driver_460.73.02-1OEM.700.0.0.15525992.vib esxcli system maintenanceMode set --enable false /etc/init.d/xorg restart

管理员步骤 5:验证 ESXi 主机是否已做好执行 NVIDIA vGPU 操作的准备

- 通过 SSH 登录到 ESXi 主机,进入 shell 模式,然后运行命令

nvidia-smi。NVIDIA 系统管理界面是由 NVIDA vGPU 主机管理器提供的命令行实用程序。运行此命令将返回主机上的 GPU 和驱动程序。 - 运行以下命令以验证是否已正确安装 NVIDIA 驱动程序:

esxcli software vib list | grep NVIDA。 - 验证主机是否配置了 GPU 直接共享并启用了 SR-IOV(如果使用的是 NVIDIA A30 或 A100 设备)。

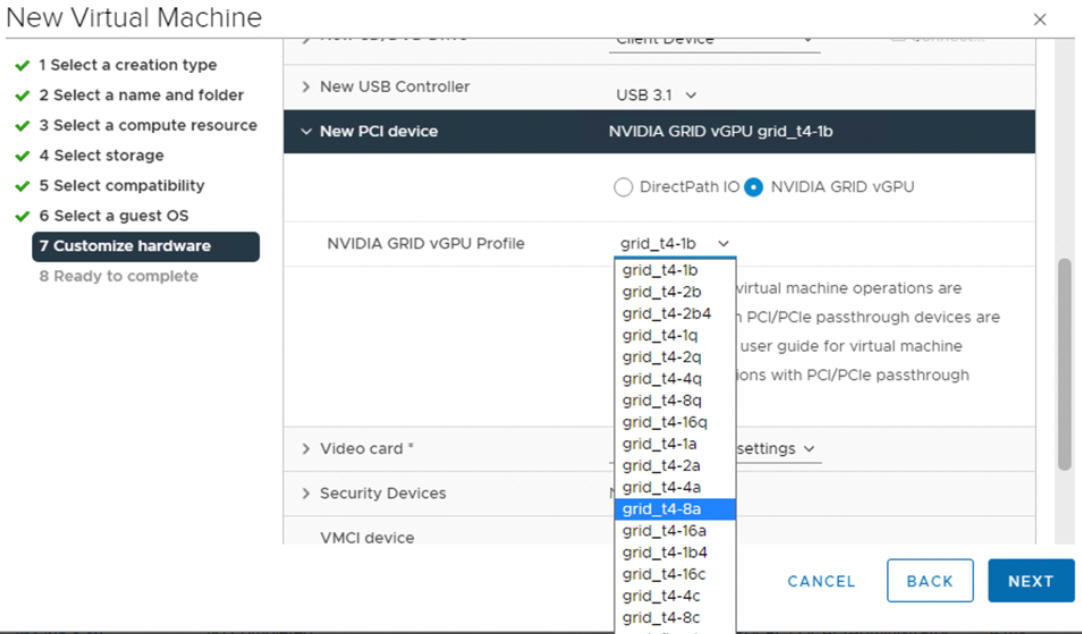

- 使用 vSphere Client,在为 GPU 配置的 ESXi 主机上创建一个包含 PCI 设备的新虚拟机。NVIDIA vGPU 配置文件应显示且可选择。

管理员步骤 6:启用工作负载管理

管理员步骤 7:使用 TKR Ubuntu 创建或更新内容库

NVIDIA vGPU 需要使用 Ubuntu 操作系统。不能对 vGPU 集群使用 PhotonOS 版本的 Tanzu Kubernetes。

VMware 提供了 Ubuntu 版本的 Tanzu Kubernetes。从 vSphere 8 开始,集群 YAML 中会使用注释指定 Ubuntu 版本。

管理员步骤 8:创建包含 vGPU 配置文件的自定义虚拟机类

创建包含 vGPU 配置文件的自定义虚拟机类。然后,将在集群规范中使用此虚拟机类创建 TKGS 集群节点。请参阅以下说明:为 NVIDIA vGPU 设备创建自定义虚拟机类。

管理员步骤 9:配置 vSphere 命名空间

为计划置备的每个 TKG vGPU 集群创建一个 vSphere 命名空间。请参见创建 vSphere 命名空间 以托管 TKG 服务 集群。

通过添加具有编辑权限的 vSphere SSO 用户/组来配置 vSphere 命名空间,并为持久卷附加一个存储策略。请参见为 TKG 服务 集群配置 vSphere 命名空间。

将存储了所需 Ubuntu 映像的 TKR 内容库与 vSphere 命名空间 相关联。请参见将 TKR 内容库与 TKG 服务 关联。

- 在“选择 vSphere 命名空间”中,选择虚拟机服务图标,然后单击管理虚拟机类。

- 在类列表中找到您创建的自定义虚拟机类。

- 选择(选中)该类,然后单击添加。

管理员步骤 10:验证 主管 是否就绪

最后一个管理任务是验证 主管 是否已置备,是否可供集群运维人员用于为 AI/ML 工作负载置备 TKG 集群。