Das Edge Services Gateway (ESG) kann als Proxy für den eingehenden Benutzerdatenverkehr angesehen werden.

Im Proxymodus verwendet der Load Balancer seine eigene IP-Adresse als Quelladresse, um Anforderungen an einen Backend-Server zu senden. Der Backend-Server interpretiert jeden Datenverkehr so, als würde er vom Load Balancer gesendet werden, und antwortet dem Load Balancer direkt. Dieser Modus wird auch als SNAT-Modus oder nicht-transparenter Modus bezeichnet. Weitere Informationen finden Sie unter Administratorhandbuch für NSX.

Ein typischer einarmiger NSX-Load-Balancer wird in demselben Subnetz wie seine Backend-Server bereitgestellt, getrennt vom logischen Router. Der virtuelle Server des NSX-Load-Balancer hört eine virtuelle IP auf eingehende Anforderungen ab und verteilt die Anforderungen an die Backend-Server. Für den Datenverkehr in der Gegenrichtung ist eine umgekehrte NAT erforderlich, um die Quell-IP-Adresse vom Backend-Server in eine virtuelle IP-Adresse (VIP) umzuwandeln und dann die VIP-Adresse an den Client zu senden. Ohne diesen Vorgang kann die Verbindung zum Client unterbrochen werden.

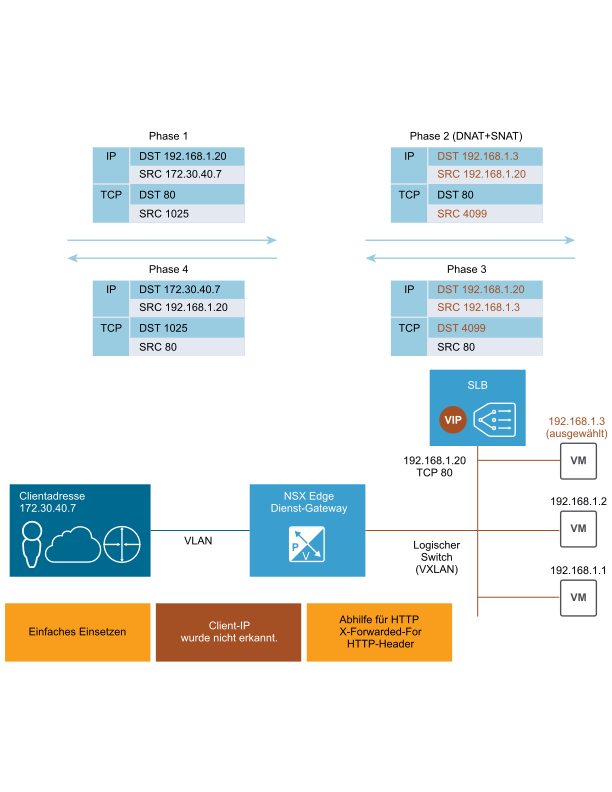

- Destination Network Address Translation (DNAT) zum Ändern der VIP-Adresse zur IP-Adresse einer der Load Balancer-Maschinen

- Source Network Address Translation (SNAT) zum Wechseln der Client-IP-Adresse mit der ESG-IP-Adresse

Dann sendet der ESG-Server den Datenverkehr an den Load-Balancer-Server und der Load-Balancer-Server sendet die Antwort zurück an das ESG und weiter an den Client. Diese Option ist sehr viel einfacher zu konfigurieren als der Inline-Modus. Es sind aber zwei potenzielle Einschränkungen vorhanden. Erstens erfordert dieser Modus einen dedizierten ESG-Server, zweitens kennen die Load-Balancer-Server die Original-IP-Adresse des Client nicht. Eine Problemumgehung für HTTP- oder HTTPS-Anwendungen besteht in der Aktivierung der Option „X-Forwarded-For“ einfügen (Insert X-Forwarded-For) im HTTP-Anwendungsprofil, damit die Client-IP-Adresse in den X-Forwarded-For-HTTP-Header der Anforderung übertragen wird, die zum Backend-Server gesendet wird.

Wenn der Backend-Server die Client-IP-Adresse für andere Anwendungen als HTTP oder HTTPS kennen muss, können Sie den IP-Pool so konfigurieren, dass er transparent ist. Wenn sich die Clients nicht in demselben Subnetz befinden wie die Backend-Server, sollte der Inline-Modus verwendet werden. Andernfalls müssen Sie die IP-Adresse des Load Balancer als Standard-Gateway des Backend-Servers verwenden.

- Inline-/Transparent-Modus

- SNAT-/Proxy-/nicht-transparenter Modus (siehe Erläuterungen weiter oben)

- Direct Server Return (SDR) – derzeit nicht unterstützt

Der folgende Vorgang erläutert die Konfiguration eines einarmigen Load Balancers mit dem Anwendungsprofil-Typ HTTPS Offloading (SSL-Offloading).