Dieser Abschnitt bietet einen ausführlichen Überblick über die dynamische Mehrfachpfadoptimierung (Dynamic Multipath Optimization, DMPO), wie sie vom VMware SD-WAN-Dienst verwendet wird.

Übersicht

VMware SD-WAN™ ist eine Lösung, die es Unternehmen und Dienstanbietern ermöglicht, mehrere WAN-Transporte zur gleichen Zeit zu nutzen. Auf diese Weise können sie die Bandbreite erhöhen und die Anwendungsleistung sicherstellen. Die Lösung funktioniert sowohl für lokale als auch für Cloud-Anwendungen (SaaS/IaaS). Sie basiert auf einer von der Cloud bereitgestellten Architektur, die ein Overlay-Netzwerk mit mehreren Tunneln aufbaut. Sie überwacht die WAN-Transporte und passt sich in Echtzeit an die Veränderungen an. Dynamische Mehrfachpfadoptimierung (DMPO) ist eine Technologie, die VMware SD-WAN entwickelt hat, um das Overlay-Netzwerk widerstandsfähiger zu machen. Sie berücksichtigt die Echtzeit-Performance der WAN-Links. In diesem Dokument werden die wichtigsten Funktionen und Vorteile von DMPO erläutert.

Das folgende Diagramm zeigt eine typische SD-WAN-Bereitstellung mit Multi-Cloud-Nicht-SD-WAN-Zielen.

Wichtigste Funktionen

- Für Unternehmensstandorte (Zweigstelle zu Zweigstelle oder Zweigstelle zu Hub) erstellen die Edges DMPO-Tunnel untereinander.

- Für Cloud-Anwendungen erstellt jeder Edge DMPO-Tunnel mit einem oder mehreren Gateways.

Kontinuierliche Überwachung

Automatische Bandbreitenermittlung: Sobald der WAN-Link vom VMware SD-WAN Edge erkannt wird, richtet er zunächst DMPO-Tunnel mit einem oder mehreren VMware SD-WAN Gateways ein und führt einen Bandbreitentest mit dem nächstgelegenen Gateway durch. Der Bandbreitentest wird durchgeführt, indem kurze Bursts mit bidirektionalem Datenverkehr gesendet und die Empfangsrate an beiden Enden gemessen wird. Da das Gateway an den Internet-PoPs eingesetzt wird, kann es auch die tatsächliche öffentliche IP-Adresse des WAN-Links identifizieren, falls sich die Edge-Schnittstelle hinter einem NAT- oder PAT-Gerät befindet. Ein ähnlicher Vorgang gilt für einen privaten Link. Für die Edges, die als Hub oder Head-End fungieren, ist die WAN-Bandbreite statisch festgelegt. Wenn jedoch der Zweigstellen-Edge einen DMPO-Tunnel mit den Hub-Edges aufbaut, folgen sie denselben Bandbreitentestverfahren, wie es zwischen einem Edge und einem Gateway auf dem öffentlichen Link der Fall ist.

Kontinuierliche Pfadüberwachung: Dynamische Mehrfachpfadoptimierung (Dynamic Multipath Optimization, DMPO) führt kontinuierliche, unidirektionale Messungen der Leistungsmetriken durch – Verlust, Latenz und Jitter jedes Pakets – in jedem Tunnel zwischen zwei beliebigen DMPO-Endpoints, Edge oder Gateway. Die Steuerung pro Paket von VMware SD-WAN ermöglicht unabhängige Entscheidungen sowohl in Uplink- als auch in Downlink-Richtung ohne asymmetrisches Routing. DMPO verwendet sowohl passive als auch aktive Überwachungsansätze. Während des Benutzerdatenverkehrs enthält der DMPO-Tunnel-Header zusätzliche Leistungsmetriken, einschließlich Sequenznummer und Zeitstempel. Dies ermöglicht den DMPO-Endpoints, verlorene und nicht ordnungsgemäße Pakete zu identifizieren und Jitter und Latenz in jeder Richtung zu berechnen. Die DMPO-Endpoints übermitteln die Leistungsmetriken des Pfades untereinander alle 100 ms.

Solange kein Benutzerdatenverkehr stattfindet, wird alle 100 ms ein aktiver Test gesendet. Nach 5 Minuten ohne Benutzerdatenverkehr mit hoher Priorität wird die Testfrequenz auf 500 ms reduziert. Diese umfassende Messung ermöglicht es der DMPO, sehr schnell auf die Veränderung der zugrunde liegenden WAN-Bedingungen zu reagieren. Dadurch ist es in der Lage, Schutz vor plötzlichen Einbrüchen der Bandbreitenkapazität und Ausfällen im WAN im Sekundenbereich zu bieten.

MPLS-Dienstklasse (Class of Service, CoS): Bei einem privaten Link mit CoS-Vereinbarung kann DMPO so konfiguriert werden, dass CoS sowohl bei der Überwachung als auch bei Entscheidungen zur Anwendungssteuerung berücksichtigt wird.

Dynamische Anwendungssteuerung

Anwendungsorientierte Steuerung pro Paket: Dynamische Mehrfachpfadoptimierung (DMPO) identifiziert Datenverkehr mithilfe von Schicht-2-7-Attributen, z. B. VLAN, IP-Adresse, Protokoll und Anwendungen. VMware SD-WAN führt eine anwendungsorientierte Steuerung pro Paket durch, die auf der Konfiguration der Business Policy und den Verbindungsbedingungen in Echtzeit basiert. Standardmäßig enthält die Business Policy sofort einsetzbare intelligente Standardwerte, die das Standardsteuerungsverhalten und die Priorität von mehr als 2.500 Anwendungen definieren: Kunden können sofort dynamische Paketsteuerung und anwendungsorientierte Priorisierung nutzen, ohne eine Richtlinie definieren zu müssen.

Während seiner gesamten Lebensdauer wird jeder Datenverkehrsflow auf einen oder mehrere DMPO-Tunnel in der Mitte der Kommunikation umgeleitet, ohne den Flow zu beeinträchtigen. Ein vollständig ausgefallener Link wird als „Ausfall“ bezeichnet. Ein Link, der keine SLA für eine bestimmte Anwendung bereitstellen kann, wird als „Brownout“ bezeichnet. VMware SD-WAN bietet Schutz vor Ausfällen und plötzlichen Einbrüchen der Bandbreitenkapazität im Sekundentakt. Durch die kontinuierliche Überwachung aller WAN-Links erkennt DMPO plötzliche SLA-Verluste oder Ausfälle innerhalb von 300-500 ms und steuert den Datenverkehr sofort, um die Anwendungsleistung zu schützen und gleichzeitig sicherzustellen, dass der aktive Flow und das Benutzererlebnis nicht beeinträchtigt werden. Es gibt eine einminütige Wartezeit ab dem Zeitpunkt, an dem der Brownout- oder Ausfallzustand auf dem Link beseitigt ist, bevor DMPO den Datenverkehr wieder auf den bevorzugten Link lenkt, sofern dies in der Business Policy festgelegt ist.

Intelligentes Lernen ermöglicht die Anwendungssteuerung auf der Grundlage des ersten Pakets der Anwendung, indem Klassifizierungsergebnisse zwischengespeichert werden. Dies ist für die anwendungsbasierte Umleitung erforderlich, z. B. für die Umleitung von Netflix auf den Internet-Link der Zweigstelle unter Umgehung des DMPO-Tunnels, während Office 365 an den regionalen Hub oder das Datencenter des Unternehmens zurückgeleitet wird.

Beispiel: Intelligente Standardwerte (Smart Defaults) legen fest, dass Microsoft Skype for Business hohe Priorität hat und eine Echtzeitanwendung ist. Angenommen, es gibt zwei Links mit einer Latenz von 50 ms bzw. 60 ms. Es wird angenommen, dass alle anderen SLAs gleich oder erfüllt sind. DMPO wählt den Link mit der besseren Latenz, d. h. den Link mit einer Latenz von 50 ms. Wenn der aktuelle Link, auf den der Skype for Business-Datenverkehr gelenkt wird, eine hohe Latenz von 200 ms aufweist, werden die Pakete für den Skype for Business-Flow in weniger als einer Sekunde auf einen anderen Link gelenkt, der eine bessere Latenz von 60 ms aufweist.

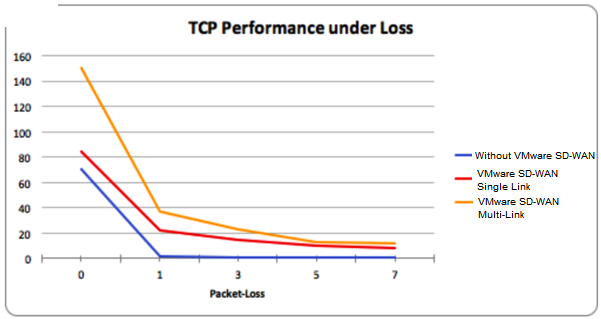

Bandbreiten-Aggregation für einen einzelnen Flow: Für die Art von Anwendungen, die von mehr Bandbreite profitieren können, wie z. B. die Dateiübertragung, führt DMPO einen Lastausgleich pro Paket durch, wobei alle verfügbaren Links verwendet werden, um alle Pakete eines einzelnen Flows an das Ziel zu liefern. DMPO berücksichtigt die WAN-Leistung in Echtzeit und entscheidet, welche Pfade für den Versand der Pakete des Flows verwendet werden sollten. Es führt auch eine erneute Sequenzierung am Empfangsende durch, um sicherzustellen, dass keine Pakete aufgrund des Lastausgleichs pro Paket in der falschen Reihenfolge ankommen.

Beispiel: Zwei 50 MBit/s-Links liefern eine aggregierte Kapazität von 100 MBit/s für einen einzigen Datenverkehrsflow. QoS wird sowohl auf der aggregierten als auch auf der individuellen Linkebene angewendet.

Bedarfsgesteuerte Standardisierung

Fehler- und Jitter-Korrektur: In einem Szenario, in dem es nicht möglich ist, den Datenverkehrsflow auf den besseren Link zu leiten, z. B. bei der Bereitstellung eines einzelnen Links oder bei gleichzeitigen Problemen auf mehreren Links, kann die dynamische Mehrfachpfadoptimierung (DMPO) Fehlerkorrekturen für die Dauer der Probleme auf den WAN-Links ermöglichen. Die Art der verwendeten Fehlerkorrekturen hängt von der Art der Anwendungen und der Art der Fehler ab.

Echtzeitanwendungen wie Audio- und Video-Flows können von der vorwärtsgerichteten Fehlerkorrektur (Forward Error Correction, FEC) profitieren, wenn es zu Paketverlusten kommt. DMPO aktiviert FEC automatisch für einzelne oder mehrere Links. Bei mehreren Links wählt DMPO bis zu zwei der jeweils besten Links für FEC aus. Doppelte Pakete werden verworfen und ungeordnete Pakete werden am Empfangsort neu sortiert, bevor sie an das endgültige Ziel weitergeleitet werden.

DMPO ermöglicht Jitter-Puffer für Echtzeitanwendungen, wenn die WAN-Links Jitter aufweisen. TCP-Anwendungen wie die Dateiübertragung profitieren von der negativen Bestätigung (Negative Acknowledgement, NACK). Wenn ein fehlendes Paket entdeckt wird, informiert der empfangende DMPO-Endpoint den sendenden DMPO-Endpoint, das fehlende Paket erneut zu übertragen. Dadurch werden die Endanwendungen vor der Erkennung von Paketverlusten geschützt, was zu einer Maximierung des TCP-Fensters führt und einen hohen TCP-Durchsatz auch bei Verlusten ermöglicht.

Wenn der Paketverlust einen bestimmten Schwellenwert überschreitet, wird die adaptive vorwärtsgerichtete Fehlerkorrektur (Forward Error Correction, FEC) durch Paketduplizierung eingeleitet. Die angewandte Fehlerkorrektur hängt von der jeweiligen Datenverkehrsklasse ab:

- Transaktions-/Massendatenverkehr: In diesem Fall wenden wir einen NACK-basierten Neuübertragungsalgorithmus an, der auf der VCMP-Protokollebene durchgeführt wird, wo wir versuchen, die Fehlerbedingung zu korrigieren, bevor wir das Paket an die Anwendung weitergeben.

- Echtzeitdatenverkehr: In diesem Fall wenden wir adaptive FEC an, um Pakete zu replizieren (Aktivieren/Deaktivieren bei Verlust-SLA-Verletzung) bzw. Korrektur des Jitter-Puffers (bei Jitter-SLA-Verletzung – diese kann nur aktiviert werden und bleibt für die gesamte Dauer des Flows bestehen).

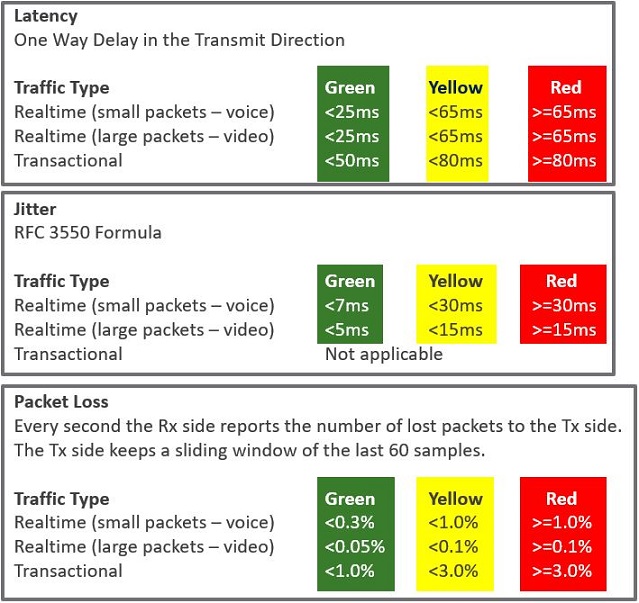

Die Link-SLA (Verlust, Latenz, Jitter) wird kontinuierlich überwacht und regelmäßig gemessen, und FEC (Paketduplizierung) wird bei Verletzung der Schwellenwerte für Echtzeitdatenverkehr aktiviert (unterschiedliche Werte für Sprach- und Videoanwendungen).

In einem Szenario mit einem einzigen WAN-Link werden doppelte Pakete nebeneinander auf demselben Link übertragen. Da die Pakete im Falle einer Überlastung nach dem Zufallsprinzip verworfen werden, ist es statistisch gesehen unwahrscheinlich, dass zwei benachbarte Pakete verworfen werden, was die Wahrscheinlichkeit, dass eines der Pakete sein Ziel erreicht, stark erhöht. Bei zwei oder mehr WAN-Links werden die replizierten Pakete über getrennte Links gesendet.

Die adaptive FEC wird auf der Grundlage gemessener Paketverlustschwellenwerte in Echtzeit pro Flow ausgelöst und in Echtzeit deaktiviert, sobald der Paketverlust die Aktivierungsschwelle nicht mehr überschreitet. Auf diese Weise wird sichergestellt, dass die verfügbare Bandbreite so effizient wie möglich genutzt wird, unnötige Paketduplizierungen vermieden und der Ressourcen-Overhead reduziert wird. Ein weiterer bedeutender Vorteil des adaptiven FEC-Ansatzes von VMware besteht darin, dass die Auswirkungen von Paketverlusten im Transportnetzwerk auf die Endbenutzergeräte minimiert oder eliminiert werden. Wenn Endbenutzergeräte keine Paketverluste feststellen, vermeiden sie erneute Übertragungen und TCP-Überlastungsvermeidungsmechanismen wie den langsamen Start, die sich negativ auf den Gesamtdurchsatz, die Anwendungsleistung und die Endbenutzererfahrung auswirken können.

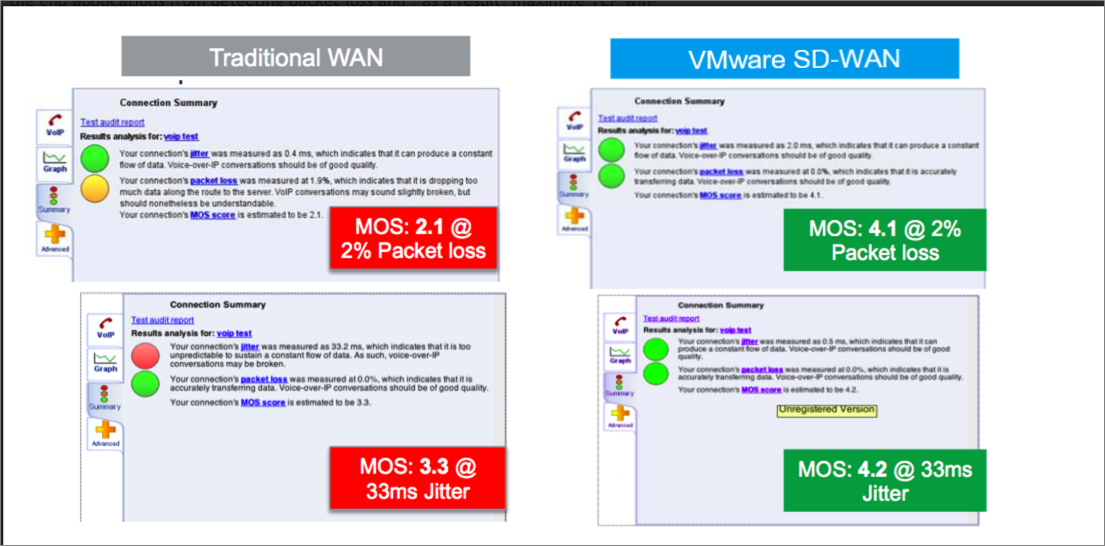

DMPO-Ergebnisse aus der Praxis

Szenario 1: VoIP-Anruf von Zweigstelle zu Zweigstelle über einen einzigen Link. Die Ergebnisse in der folgenden Abbildung zeigen die Vorteile der bedarfsgesteuerten Standardisierung mit FEC und Jitter-Standardisierung auf einem einzelnen Internet-Link mit herkömmlichem WAN und VMware SD-WAN. Ein mittlerer Meinungswert (Mean Opinion Score, MOS) von weniger als 3,5 gilt als inakzeptable Qualität für einen Sprach- oder Videoanruf.

Szenario 2: TCP-Leistung mit und ohne VMware SD-WAN für einzelne und mehrere Links. Diese Ergebnisse zeigen, wie NACK den Lastausgleich pro Paket ermöglicht.

Szenario 3: Hybrid-WAN-Szenario mit einem Ausfall auf dem MPLS-Link und sowohl Jitter als auch Verlust auf dem Internet-(Comcast-)Link. Diese Ergebnisse zeigen, wie DMPO Anwendungen vor Ausfällen von weniger als einer Sekunde schützt, indem es sie auf Internet-Links umleitet und eine bedarfsgesteuerte Standardisierung auf dem Internet-Link ermöglicht.

Business Policy-Framework und intelligente Standardwerte

Mit der Business Policy kann der IT-Administrator QoS, Steuerung und Dienste für den Anwendungsdatenverkehr kontrollieren. Die Funktion für intelligente Standardwerte (Smart Defaults) stellt eine vorgefertigte Business Policy bereit, die über 2.500 Anwendungen unterstützt. DMPO trifft Steuerungsentscheidungen auf der Grundlage der Art der Anwendung, der Echtzeit-Link-Bedingungen (Überlastung, Latenz, Jitter und Paketverluste) und der Business Policy. Hier ist ein Beispiel für eine Business Policy.

Jede Anwendung hat eine Kategorie. Jede Kategorie verfügt über eine Standardaktion, die aus einer Kombination von Business Priority, Netzwerkdienst, Link-Steuerung und Dienstklasse besteht. Sie können auch benutzerdefinierte Anwendungen definieren.

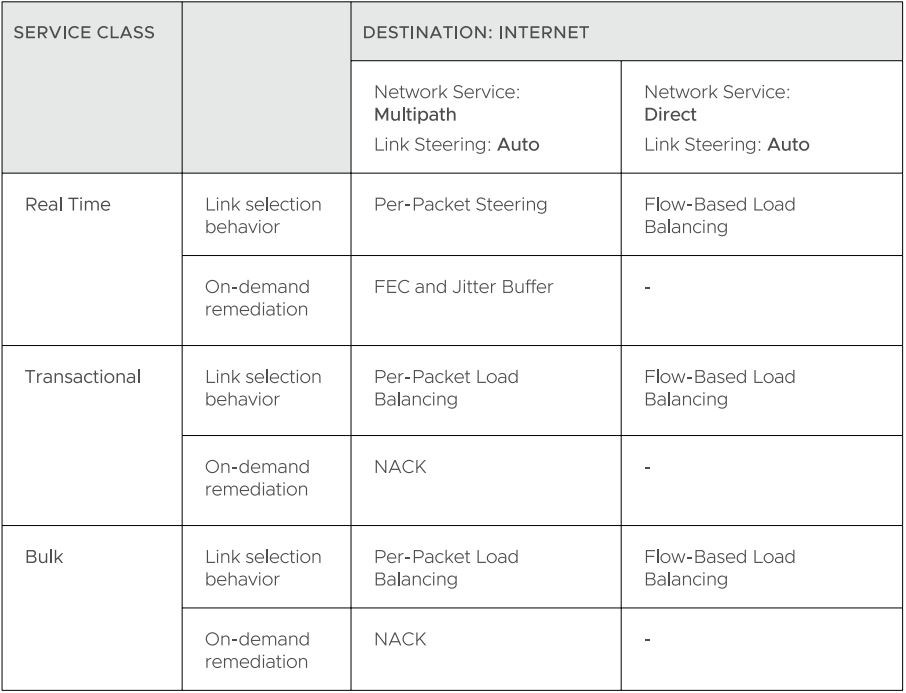

Jede Anwendung verfügt über eine Dienstklasse: Echtzeit (Real Time), Transaktional (Transactional) oder Massen (Bulk). Die Dienstklasse bestimmt, wie DMPO den Anwendungsdatenverkehr verarbeitet. Sie können die Dienstklasse für die Standardanwendungen nicht ändern, aber Sie können sie für Ihre eigenen benutzerdefinierten Anwendungen angeben.

Jede Anwendung hat auch eine Business Priority: Hoch (High), Normal oder Niedrig (Low). Die Business Priority bestimmt, wie DMPO dem Anwendungsdatenverkehr Priorität einräumt und QoS anwendet. Sie können die Business Priority für jede Anwendung ändern.

Es gibt drei Typen von Netzwerkdiensten: Direkt (Direct), MultiPath und Internet-Backhaul (Internet Backhaul). Standardmäßig wird einer Anwendung einer der Standard-Netzwerkdienste zugewiesen, die von den Kunden geändert werden können.

- Direkt: Diese Aktion wird in der Regel für nicht kritische, vertrauenswürdige Internetanwendungen verwendet, die direkt unter Umgehung des DMPO-Tunnels gesendet werden sollen. Ein Beispiel ist Netflix. Netflix gilt als nicht geschäftskritische Anwendung mit hoher Bandbreite und sollte nicht über die DMPO-Tunnel gesendet werden. Für den direkt gesendeten Datenverkehr kann ein Lastausgleich auf Flow-Ebene vorgenommen werden. Standardmäßig erhalten alle Anwendungen mit niedriger Priorität die Aktion Direkt für Netzwerkdienst.

- MultiPath: Diese Aktion wird in der Regel für wichtige Anwendungen durchgeführt. Durch Einfügen des Multipath-Diensts wird der internetbasierte Datenverkehr an das VMware SD-WAN-Gateway gesendet. Die folgende Tabelle zeigt die standardmäßige Link-Steuerung und die bedarfsgesteuerte Standadisierungstechnik für eine bestimmte Dienstklasse. Standardmäßig erhalten Anwendungen mit hoher und normaler Priorität die Multipath-Aktion für den Netzwerkdienst.

- Internet-Backhaul: Bei dieser Aktion werden die Internetanwendungen an einen Unternehmensstandort umgeleitet, der über den VMware SD-WAN Edge verfügen kann oder auch nicht. Der typische Anwendungsfall besteht darin, wichtige Internetanwendungen durch einen Standort zu leiten, der über Sicherheitsvorrichtungen wie Firewall, IPS und Inhaltsfilterung verfügt, bevor der Datenverkehr in das Internet geleitet wird.

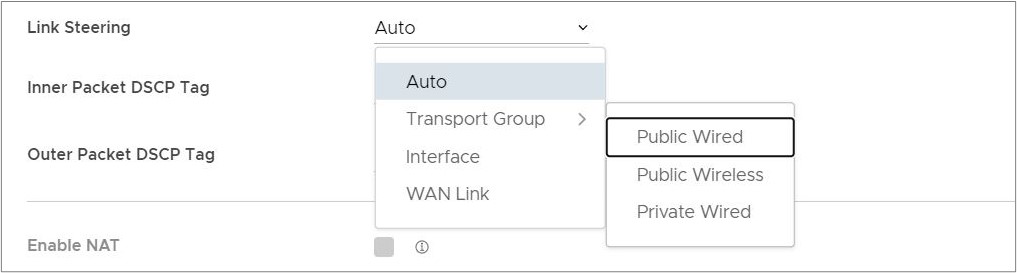

Link-Steuerungs-Abstraktion mit Transportgruppe

An verschiedenen Zweigstellen und Hub-Standorten kann es verschiedene Modelle des VMware SD-WAN Edge mit unterschiedlichen WAN-Schnittstellen und ‑Betreibern geben. Um die zentralisierte Link-Steuerungsrichtlinie mithilfe von Profilen durchzusetzen, ist es wichtig, dass die Schnittstellen und Betreiber abstrahiert werden. Die Transportgruppe bietet die Abstraktion der tatsächlichen Schnittstellen der an verschiedenen Standorten eingesetzten Geräte und Betreiber. Die Business Policy auf der Profilebene kann stattdessen auf die Transportgruppe angewendet werden, während die Business Policy auf der individuellen Edge-Ebene auf die Transportgruppe, den WAN-Link (Betreiber) und die -Schnittstellen angewendet werden kann.

Link-Steuerung nach Transportgruppe

Verschiedene Standorte können über unterschiedliche WAN-Transporte verfügen, z. B. WAN-Betreibername, WAN-Schnittstellenname. DMPO verwendet das Konzept der Transportgruppe, um die zugrunde liegenden WAN-Betreiber oder ‑Schnittstellen von der Business Policy-Konfiguration zu abstrahieren. Die Business Policy-Konfiguration kann die Transportgruppe (öffentlich verkabelt, öffentlich drahtlos, privat verkabelt usw.) in der Steuerungsrichtlinie angeben, sodass dieselbe Konfiguration der Business Policy auf verschiedene Gerätetypen oder Standorte angewendet werden kann, die völlig unterschiedliche WAN-Betreiber und WAN-Schnittstellen usw. haben können. Wenn die DMPO die WAN-Link-Erkennung durchführt, weist sie auch die Transportgruppe dem WAN-Link zu. Dies ist die wünschenswerteste Option für die Festlegung der Verbindungen in der Business Policy, da dadurch die IT-Administratoren die physische Konnektivität oder den WAN-Betreiber nicht kennen müssen.

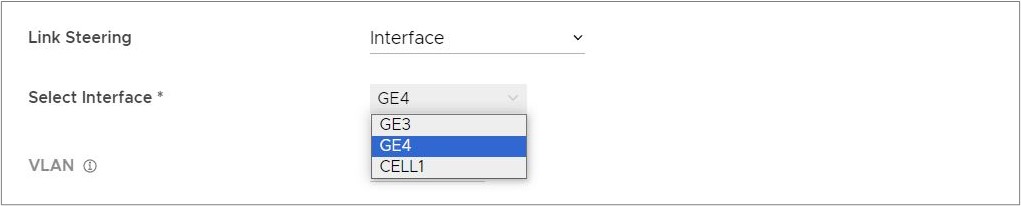

Link-Steuerung nach Schnittstelle

Die Link-Steuerungsrichtlinie kann auf die Schnittstelle angewendet werden, z. B. GE2, GE3, die je nach Edge-Modell und Standort unterschiedlich sein wird. Dies ist die am wenigsten wünschenswerte Option für die Business Policy, da die IT-Administratoren genau wissen müssen, wie der Edge verbunden ist, um die zu verwendende Schnittstelle festlegen zu können.

Link-Steuerung und bedarfsgesteuerte Standardisierung

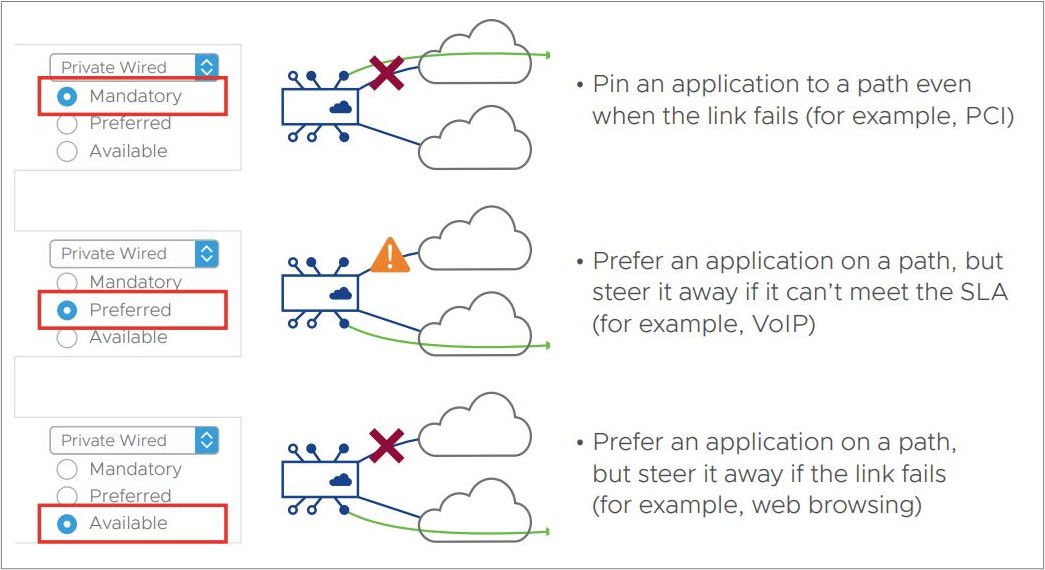

Es gibt vier mögliche Optionen für die Link-Steuerung: Automatisch (Auto), Bevorzugt (Preferred), Obligatorisch (Mandatory) und Verfügbar (Available).

Link-Auswahl: Obligatorisch – Binden Sie den Datenverkehr an den Link oder die Transportgruppe. Der Datenverkehr wird niemals umgeleitet, unabhängig vom Zustand der Verbindung, einschließlich eines Ausfalls. Bedarfsgesteuerte Standardisierung wird ausgelöst, um Brownout-Bedingungen wie Paketverlust und Jitter zu mindern.

Beispiel: Netflix ist eine Anwendung mit niedriger Priorität und muss immer auf den öffentlichen kabelgebundenen Links bleiben.

Link-Auswahl: Bevorzugt – Wählen Sie den Link aus, der als „bevorzugt“ markiert werden soll. Je nach Typ der auf dem Edge verfügbaren WAN-Links gibt es drei mögliche Szenarien:

- Für den bevorzugten Internet-Link gibt es mehrere Alternativen für öffentliche WAN-Links: Der Anwendungsdatenverkehr bleibt auf dem bevorzugten Link, solange er die SLA für diese Anwendung erfüllt, und wird auf andere öffentliche Links umgeleitet, sobald der bevorzugte Link die von der Anwendung benötigte SLA nicht mehr erfüllen kann. Wenn es keinen Link gibt, auf den umgeleitet werden kann, d. h. wenn alle öffentlichen Links die von der Anwendung geforderte SLA nicht erfüllen können, wird die bedarfsgesteuerte Standardisierung aktiviert. Anstatt die Anwendung umzuleiten, sobald der aktuelle Link die von der Anwendung geforderte SLA nicht erfüllen kann, kann DMPO die bedarfsgesteuerte Standardisierung aktivieren, bis die Verschlechterung zu gravierend ist, um behoben zu werden, und die Anwendung dann auf einen besseren Link umleiten.

- Beispiel: Bevorzugen Sie die Video-Collaboration-Anwendung auf dem Internet-Link, bis dieser das für Video erforderliche SLA nicht mehr erfüllen kann, und leiten Sie die Anwendung dann auf einen öffentlichen Link um, der die SLA für diese Anwendung erfüllt.

- Für den bevorzugten Internet-Link gibt es mehrere Alternativen für öffentliche WAN-Links und private WAN-Links: Der Anwendungsdatenverkehr bleibt auf dem bevorzugten Link, solange er die SLA für diese Anwendung erfüllt, und wird auf einen anderen öffentlichen Link umgeleitet, sobald der bevorzugte Link die für die Anwendung erforderliche SLA nicht mehr erfüllen kann. Der bevorzugte Link wird im Falle eines SLA-Ausfalls NICHT auf einen privaten Link umgeleitet, sondern nur dann, wenn sowohl der bevorzugte Link als auch ein anderer öffentlicher Link entweder instabil oder vollständig ausgefallen sind. Wenn es keinen Link gibt, auf den umgeleitet werden kann, d. h. wenn ein anderer öffentlicher Link die von der Anwendung benötigte SLA nicht erfüllen kann, wird die bedarfsgesteuerte Standardisierung aktiviert. Anstatt die Anwendung umzuleiten, sobald der aktuelle Link die von der Anwendung geforderte SLA nicht erfüllen kann, kann DMPO die bedarfsgesteuerte Standardisierung aktivieren, bis die Verschlechterung zu gravierend ist, um behoben zu werden, und die Anwendung dann auf einen besseren Link umleiten.

- Beispiel A: Bevorzugen Sie die Video-Collaboration-Anwendung auf dem Internet-Link, bis dieser die für Video erforderliche SLA nicht mehr erfüllen kann, und leiten Sie die Anwendung dann auf einen öffentlichen Link um, der die SLA für diese Anwendung erfüllt.

- Beispiel B: Bevorzugen Sie die Video Collaboration-Anwendung auf dem Internet-Link, bis dieser instabil wird oder vollständig ausfällt, andere öffentliche Links ebenfalls instabil sind oder ebenfalls vollständig ausgefallen sind, und leiten Sie dann auf einen verfügbaren privaten Link um.

- Wenn der bevorzugte Internet-Link nur über Alternativen zu privaten WAN-Links verfügt: Der Anwendungsdatenverkehr verbleibt auf dem bevorzugten Link, unabhängig vom SLA-Status für diese Anwendung, und wird nicht auf andere private Links umgeleitet, selbst wenn der bevorzugte Link die von der Anwendung benötigte SLA nicht liefern kann. Anstelle der Umleitung auf die privaten Links bei einem SLA-Ausfall für diese Anwendung wird die bedarfsgesteuerte Standardisierung aktiviert. Der bevorzugte Link würde nur dann auf den/die privaten Link(s) umleiten, wenn der bevorzugte Link entweder instabil oder komplett ausgefallen ist.

- Beispiel: Bevorzugen Sie die Video Collaboration-Anwendung auf dem Internet-Link, bis der Link instabil wird oder ganz ausfällt, und leiten Sie dann auf einen verfügbaren privaten Link um.

Link-Auswahl: Verfügbar – Diese Option wählt den verfügbaren Link aus, solange er aktiv ist. DMPO aktiviert die bedarfsgesteuerte Standardisierung, wenn der Link die SLA nicht erfüllt. DMPO leitet die Anwendungsflüsse nicht auf einen anderen Link, es sei denn, der Link ist inaktiv.

Beispiel: Der Web-Datenverkehr wird über den Internet-Link per Backhaul zur Hub-Site geleitet, wobei der Internet-Link so lange genutzt wird, wie er aktiv ist, unabhängig von der SLA.

Link-Auswahl: Automatisch – Dies ist die Standardoption für alle Anwendungen. DMPO wählt automatisch die besten Links basierend auf dem Anwendungstyp aus und aktiviert bei Bedarf die bedarfsgesteuerte Standardisierung. Es gibt vier mögliche Kombinationen der Link-Steuerung und bedarfsgesteuerten Standardisierung für Internetanwendungen. Der Datenverkehr innerhalb des Unternehmens (VPN) durchläuft immer die DMPO-Tunnel. Daher können die Vorteile der bedarfsgesteuerten Standardisierung immer genutzt werden.

In den folgenden Beispielen wird das standardmäßige DMPO-Verhalten für verschiedene Arten von Anwendungen und Linkbedingungen erläutert. Im Anhang finden Sie die Standard-SLA für verschiedene Anwendungstypen.

Beispiel: Echtzeitanwendungen.

- Szenario: Es gibt einen Link, der die SLA für die Anwendung erfüllt.

Erwartetes DMPO-Verhalten: Der beste verfügbare Link wird ausgewählt.

- Szenario: Es gibt einen Link mit Paketverlust über der SLA für die Anwendung.

Erwartetes DMPO-Verhalten: FEC wird für die Echtzeitanwendungen auf diesem Link aktiviert.

- Szenario: Es gibt zwei Links mit Verlust auf nur einem Link.

Erwartetes DMPO-Verhalten: FEC wird auf beiden Links aktiviert.

- Szenario: Es gibt mehrere Links mit Verlust auf mehreren Links.

Erwartetes DMPO-Verhalten: FEC wird auf den beiden besten Links aktiviert.

- Szenario: Es gibt zwei Links, aber ein Link ist instabil, d. h., es fehlen drei aufeinanderfolgende Taktsignale.

Erwartetes DMPO-Verhalten: Der Link wird als unbrauchbar markiert und der Flow wird zum nächstbesten verfügbaren Link geleitet.

- Szenario: Es gibt zwei Links mit sowohl Jitter als auch Verlust.

Erwartetes DMPO-Verhalten: FEC und Jitter-Puffer werden auf beiden Links aktiviert. Der Jitter-Puffer wird aktiviert, wenn der Jitter mehr als 7 ms für Audio und mehr als 5 ms für Video beträgt. Der sendende DMPO-Endpoint benachrichtigt den empfangenden DMPO-Endpoint, um Jitter-Puffer zu aktivieren. Der empfangende DMPO-Endpoint puffert bis zu 10 Pakete oder 200 ms an Datenverkehr, je nachdem, was zuerst eintritt. Es verwendet den ursprünglichen Zeitstempel in der DMPO-Kopfzeile, um die Flow-Rate zu berechnen, die im Puffer zur Jitter-Aufhebung verwendet werden soll. Wenn der Flow nicht konstant ist, wird die Jitter-Pufferung deaktiviert.

Beispiel: Transaktions- und Massenanwendungen. Aktiviert NACK, wenn der Paketverlust den für den jeweiligen Anwendungstyp akzeptablen Schwellenwert überschreitet (siehe Anhang zu diesem Wert).

Sichere Datenverkehrsübertragung

DMPO verschlüsselt sowohl die Nutzlast als auch den Tunnel-Header mit dem IPsec-Transportmodus End-to-End für privaten oder internen Datenverkehr. Die Nutzlast enthält den Benutzerdatenverkehr. DMPO unterstützt AES128 und AES256 für die Verschlüsselung. Es verwendet die PKI- und IKEv2-Protokolle für die Verwaltung und Authentifizierung von IPsec-Schlüsseln.

Verwendete Protokolle und Ports

DMPO verwendet die folgenden Ports:

- UDP/2426 – UDP/2426: Dieser Port dient der Overlay-Tunnelverwaltung und dem Informationsaustausch zwischen den beiden DMPO-Endpoints (Edges und Gateways). Er ist auch für Datenverkehr vorgesehen, der bereits gesichert oder unwichtig ist, wie z. B. SFDC-Datenverkehr von der Zweigstelle zur Cloud zwischen Edge und Gateway. SFDC-Datenverkehr wird mit TLS verschlüsselt.

- UDP/500 und UDP/4500 – Diese Ports sind für die IKEv2-Aushandlung und für die IPSec-NAT-Transparenz.

- IP/50 – Dieses Protokoll ist für IPSec über das native IP-Protokoll 50 (ESP) vorgesehen, wenn kein NAT zwischen den beiden DMPO-Endpoints besteht.

Anhang: QoE-Schwellenwert und Anwendungs-SLA

DMPO verwendet den folgenden SLA-Schwellenwert für verschiedene Arten von Anwendungen. Wenn der Zustand des WAN-Links einen oder mehrere Schwellenwerte überschreitet, ergreift DMPO sofort Maßnahmen, um die betroffenen Anwendungs-Flows zu steuern oder eine bedarfsgesteuerte Standardisierung durchzuführen. Der Paketverlust wird berechnet, indem die Anzahl der verlorenen Pakete durch die Gesamtzahl der Pakete im letzten 1-Minuten-Intervall geteilt wird. Die DMPO-Endpoints kommunizieren jede Sekunde über die Anzahl verloren gegangener Pakete. Der QoE-Bericht spiegelt diesen Schwellenwert ebenfalls wider.

DMPO ergreift auch sofort Maßnahmen, wenn es innerhalb von 300 ms die Kommunikation verliert (keine Benutzerdaten oder Tests).