vSphere IaaS control plane comprend deux rôles, l'administrateur vSphere et l'ingénieur DevOps. L'ingénieur DevOps comprend le rôle d'administrateur DevOps, de développeur d'applications et d'administrateur Kubernetes. Les deux rôles interagissent avec la plate-forme via différentes interfaces et peuvent avoir des utilisateurs ou des groupes d'utilisateurs définis pour eux dans vCenter Server avec les autorisations associées. Les workflows des rôles d'administrateur vSphere et d'ingénieur DevOps sont distincts et déterminés par le domaine d'expertise spécifique dont ces rôles ont besoin.

Rôles d'utilisateur et workflows

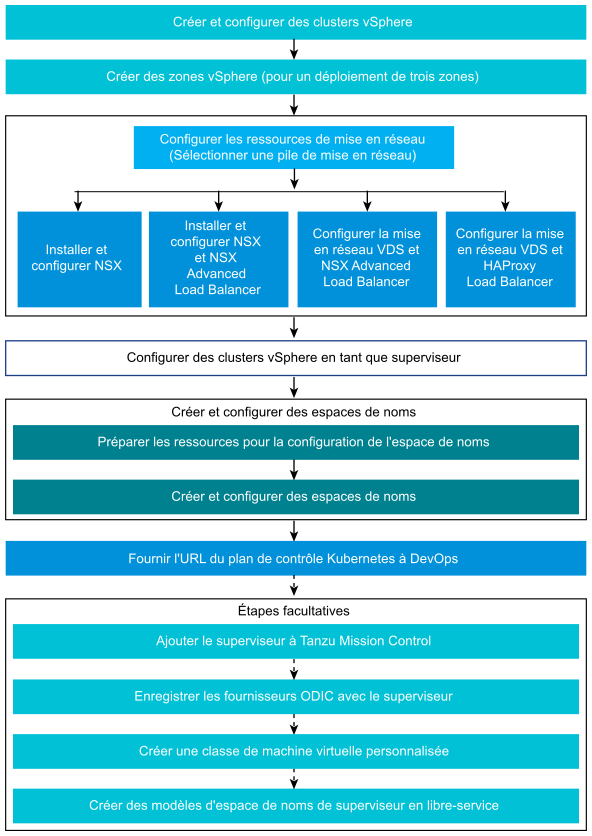

En tant qu'administrateur vSphere, l'interface principale grâce à laquelle vous interagissez avec vSphere IaaS control plane est vSphere Client. À haut niveau, vos responsabilités impliquent la configuration d'un Superviseur et d'espaces de noms, dans lesquels les ingénieurs DevOps peuvent déployer des charges de travail Kubernetes. Vous devez avoir une excellente connaissance de l'équilibrage de charge vSphere, NSX Advanced Load Balancer ou HAProxy, NSX (sélectionnez-vous cette pile de mise en réseau) et une compréhension de base sur Kubernetes.

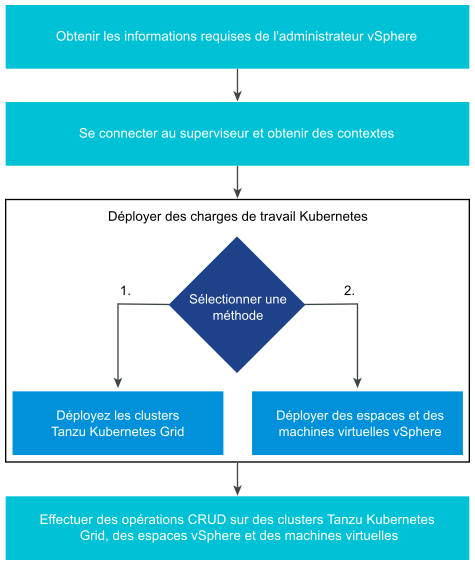

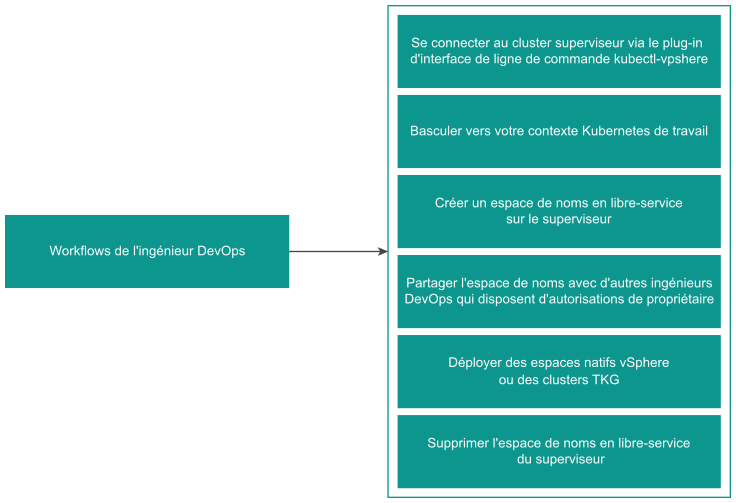

En tant qu'ingénieur DevOps, vous pouvez être un développeur Kubernetes et un propriétaire d'application, un administrateur Kubernetes ou combiner des fonctions des deux catégories. En tant qu'ingénieur DevOps, vous utilisez des commandes kubectl pour déployer des Espaces vSphere et des machines virtuelles sur un espace de noms existant, et vous utilisez kubectl et Tanzu CLI pour déployer et gérer des clusters Tanzu Kubernetes Grid. En tant qu'ingénieur DevOps, vous n'avez généralement pas besoin d'être un expert sur vSphere NSX, vDS, ou NSX Advanced Load Balancer et HAProxy, mais vous devez disposer d'une compréhension de base concernant ces technologies et la plate-forme afin d'interagir plus efficacement avec les administrateurs vSphere.

Superviseur avec mise en réseau VDS et workflow NSX Advanced Load Balancer

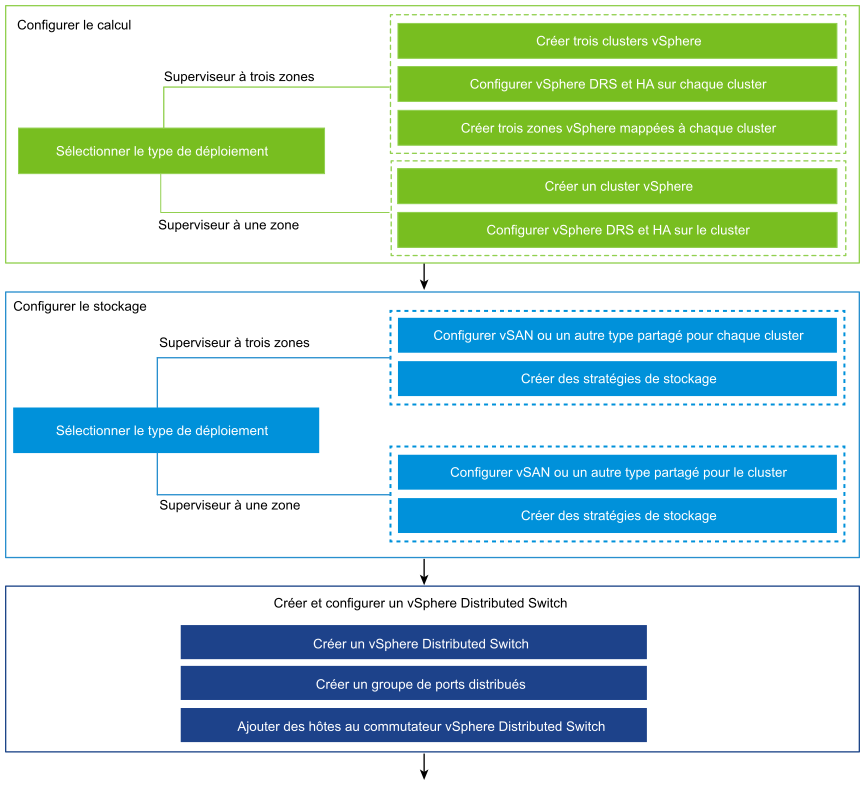

En tant qu'administrateur vSphere, vous pouvez configurer des clusters vSphere en tant que Superviseur avec la pile de mise en réseau vSphere via un VDS et NSX Advanced Load Balancer. Vous pouvez configurer un Superviseur de zone unique mappée à un seul cluster vSphere ou un Superviseur de trois zones mappées à trois clusters vSphere. Pour plus d'informations sur la configuration système requise, reportez-vous à la section Conditions requises pour l'activation d'un superviseur de zone unique avec NSX Advanced Load Balancer et Conditions requises pour un superviseur de trois zones avec NSX Advanced Load Balancer. Pour plus d'informations sur l'activation d'un Superviseur avec la mise en réseau VDS, reportez-vous à la section Installation et configuration dans Installation et configuration du plan de contrôle IaaS vSphere.

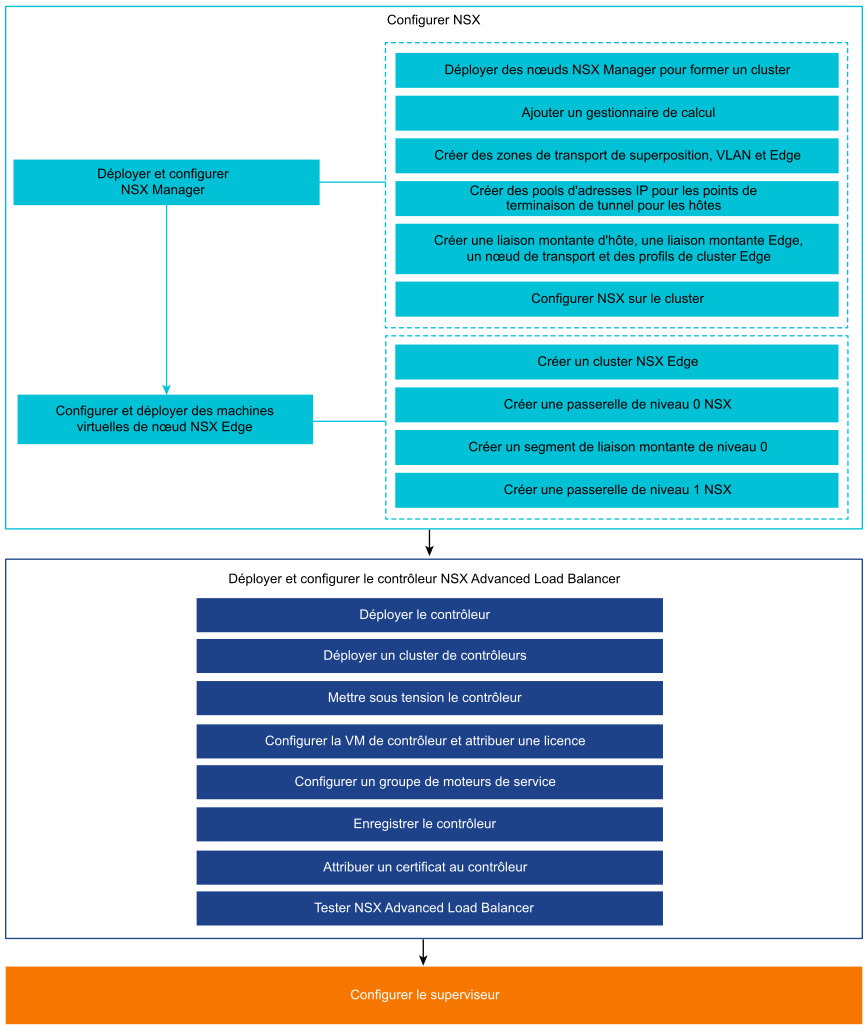

Superviseur avec mise en réseau NSX et workflow Contrôleur NSX Advanced Load Balancer

Vous pouvez configurer un Superviseur à une ou trois zones avec la pile de mise en réseau NSX et le Contrôleur NSX Advanced Load Balancer. Pour plus d'informations sur la configuration requise, reportez-vous aux sections Conditions requises pour le déploiement d'un Superviseur de clusters avec NSX et NSX Advanced Load Balancer et Conditions requises pour le déploiement zonal du Superviseur avec NSX et NSX Advanced Load Balancer. Pour connaître la procédure d'installation, reportez-vous à la section Installer et configurer NSX et NSX Advanced Load Balancer.

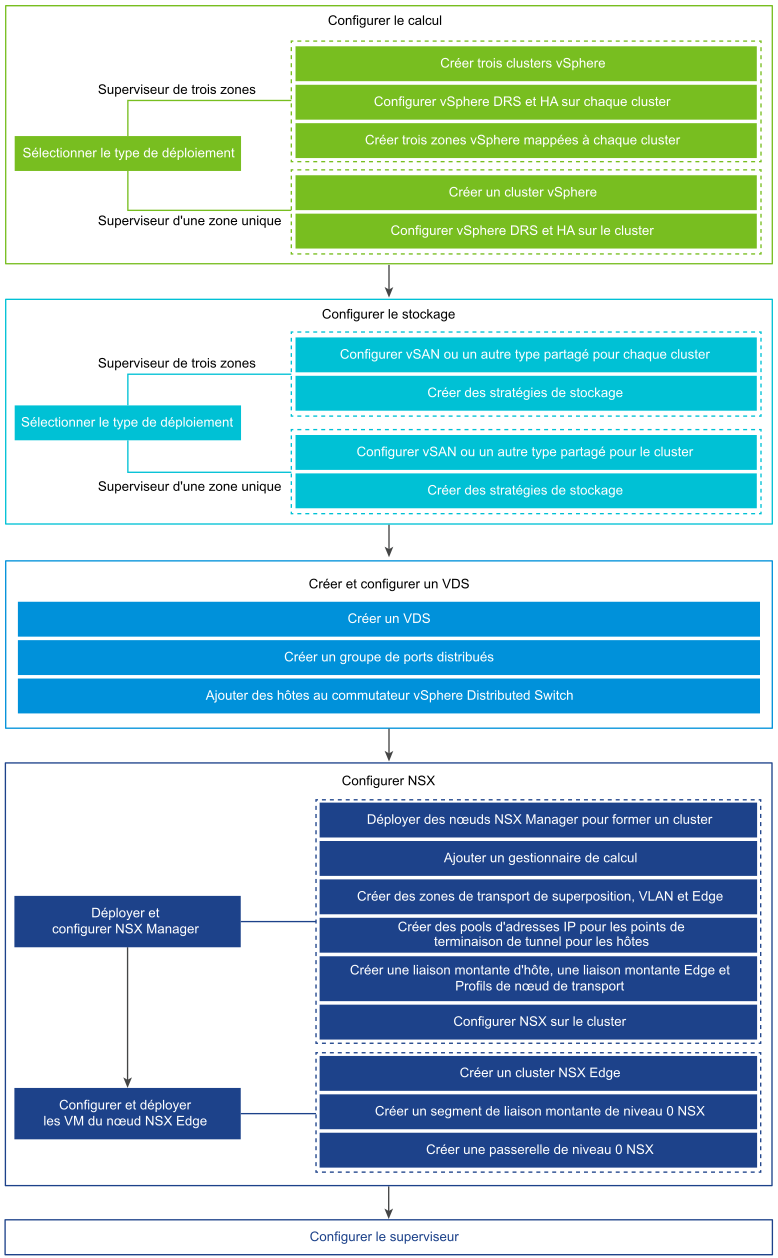

Superviseur avec le workflow de mise en réseau NSX

Vous pouvez également configurer un Superviseur de zone unique ou de trois zones avec NSX comme pile de mise en réseau. Pour plus d'informations sur la configuration système requise, reportez-vous aux sections Conditions requises pour l'activation d'un superviseur de zone unique avec NSX et Conditions requises pour l'activation d'un superviseur de trois zones avec NSX. Pour obtenir des instructions d'installation, reportez-vous à la section Installation et configuration dans Installation et configuration du plan de contrôle IaaS vSphere.

Superviseur avec la mise en réseau VDS et équilibrage de charge HAProxy

En tant qu'administrateur vSphere, vous pouvez activer un Superviseur sur une ou trois zones vSphere mappées à des clusters vSphere à l'aide de la pile de mise en réseau VDS et de l'équilibrage de charge HAProxy. Pour plus d'informations sur la configuration système requise, reportez-vous à la section Conditions requises pour l'activation d'un superviseur de zone unique avec la mise en réseau VDS et l'équilibrage de charge HAProxy et Conditions requises pour l'activation d'un superviseur de trois zones avec la mise en réseau VDS et l'équilibrage de charge HAProxy. Pour obtenir des instructions d'installation, reportez-vous à la section Installation et configuration dans Installation et configuration du plan de contrôle IaaS vSphere.

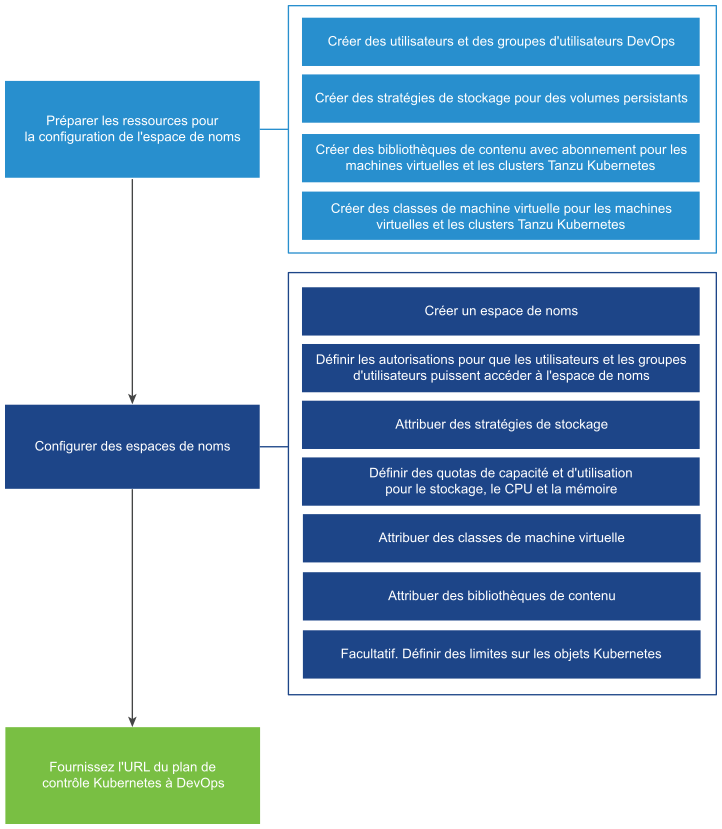

Workflow de création et de configuration de l'espace de noms

Une fois que vous avez activé un Superviseur, en tant qu'administrateur vSphere, vous créez et configurez des Espaces de noms vSphere sur le Superviseur. Vous devez collecter des exigences spécifiques en matière de ressources auprès des ingénieurs DevOps sur les applications et les charges de travail qu'ils souhaitent exécuter, et configurer les espaces de noms en conséquence. Pour plus d'informations, reportez-vous à la section Configuration et gestion des espaces de noms vSphere.

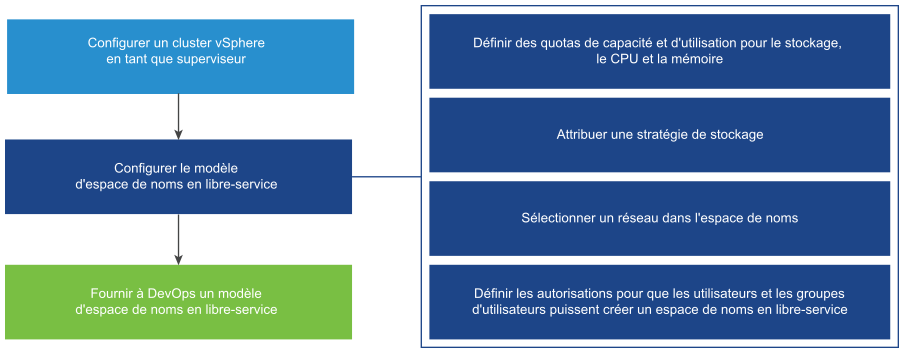

Workflow de création et de configuration d'un espace de noms en libre-service

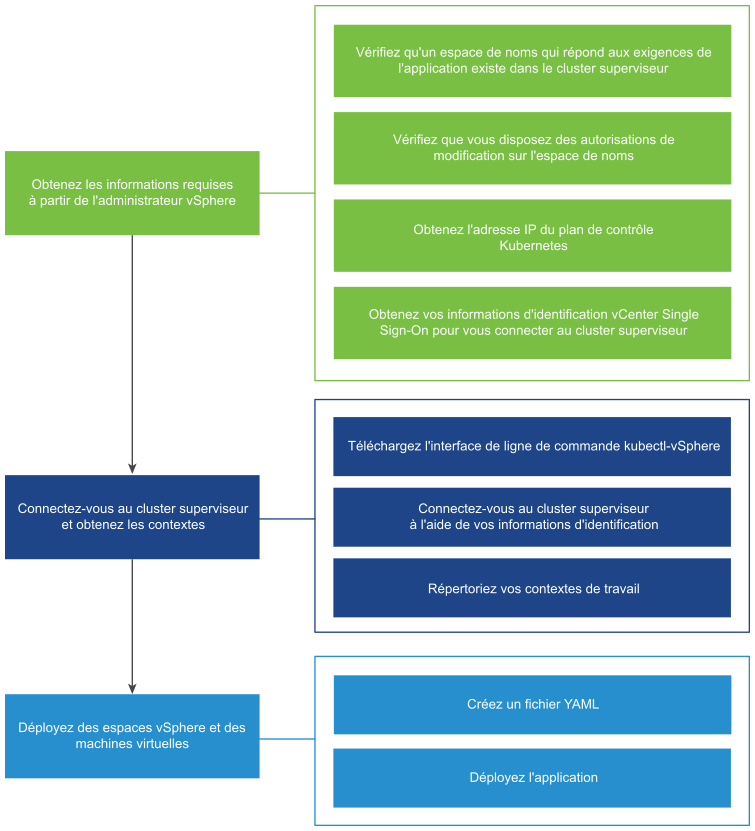

Workflow de provisionnement d'Espace vSphere et de machines virtuelles

En tant qu'ingénieur DevOps, vous pouvez déployer des Espaces vSphere et des machines virtuelles dans les limites de ressources d'un espace de noms qui s'exécute sur un Superviseur. Pour plus d'informations, reportez-vous aux sections Déploiement de charges de travail sur des espaces vSphere et Déploiement et gestion de machines virtuelles dans Services et charges de travail du plan de contrôle IaaS vSphere.

Workflow provisionnement du cluster Tanzu Kubernetes Grid

En tant qu'ingénieur DevOps, vous créez et configurez des clusters Tanzu Kubernetes Grid sur Espaces de noms vSphere. Pour plus d'informations, consultez le guide Utilisation du service TKG avec le plan de contrôle IaaS vSphere.