영구 메모리를 사용하는 NVM(비휘발성 메모리) 스토리지 디바이스는 데이터 센터에서 널리 사용되고 있습니다. 로컬 및 네트워크 NVM 디바이스에 연결하기 위해 ESXi는 NVM 디바이스와의 고성능 다중 대기열 통신을 위해 특별히 설계된 표준화된 프로토콜인 NVMe(NVM Express) 프로토콜을 사용합니다.

VMware NVMe 개념

ESXi 환경에서 NVMe 스토리지 작업을 시작하기 전에 기본 NVMe 개념에 대해 알아봅니다.

- NVMe(NVM Express)

- NVMe는 호스트와 대상 스토리지 시스템 간에 데이터를 연결하고 전송하는 방법입니다. NVMe는 플래시 디바이스와 같은 비휘발성 메모리가 장착된 고속 스토리지 미디어와 함께 사용하도록 설계되었습니다. 이런 유형의 스토리지는 짧은 지연 시간, 낮은 CPU 사용량 및 고성능을 달성할 수 있으며 일반적으로 SCSI 스토리지의 대안으로 사용됩니다.

- NVMe 전송

- NVMe 스토리지는 PCIe 인터페이스를 사용하여 호스트에 직접 연결하거나 다른 패브릭 전송을 통해 간접적으로 연결할 수 있습니다. VMware NVMe-oF(NVMe over Fabrics)는 공유 스토리지 어레이에 있는 대상 스토리지 디바이스와 호스트 간에 원거리 연결을 제공합니다.

- NVMe 네임스페이스

- NVMe 스토리지 어레이에서 네임스페이스는 일정량의 비휘발성 메모리가 지원하는 스토리지 볼륨입니다. ESXi 컨텍스트에서 네임스페이스는 스토리지 디바이스 또는 LUN과 유사합니다. ESXi 호스트가 NVMe 네임스페이스를 검색하면 네임스페이스를 나타내는 플래시 디바이스가 vSphere Client의 스토리지 디바이스 목록에 표시됩니다. 이 디바이스를 사용하여 데이터스토어를 생성하고 가상 시스템을 저장할 수 있습니다.

- NVMe 컨트롤러

- 컨트롤러는 하나 이상의 NVMe 네임스페이스와 연결되어 있으며 스토리지 어레이의 네임스페이스와 ESXi 호스트 사이에 액세스 경로를 제공합니다. 컨트롤러에 액세스하기 위해 호스트는 컨트롤러 검색과 컨트롤러 연결이라는 두 가지 메커니즘을 사용할 수 있습니다. 자세한 내용은 NVMe over Fabrics용 컨트롤러 추가 항목을 참조하십시오.

- 컨트롤러 검색

- 이 메커니즘을 사용하면 ESXi 호스트가 먼저 검색 컨트롤러에 연락합니다. 검색 컨트롤러는 사용 가능한 컨트롤러 목록을 반환합니다. 호스트가 액세스할 컨트롤러를 선택하면 이 컨트롤러와 연결된 모든 네임스페이스를 호스트에서 사용할 수 있게 됩니다.

- 컨트롤러 연결

- ESXi 호스트가 지정한 컨트롤러에 연결됩니다. 이 컨트롤러와 연결된 모든 네임스페이스를 호스트에서 사용할 수 있게 됩니다.

- NVMe 하위 시스템

- 일반적으로 NVMe 하위 시스템은 스토리지 어레이이며, 여기에는 여러 NVMe 컨트롤러, 여러 네임스페이스, 비휘발성 메모리 스토리지 매체, 컨트롤러와 비휘발성 메모리 스토리지 매체 간의 인터페이스가 포함될 수 있습니다. 하위 시스템은 하위 시스템 NQN(NVMe Qualified Name)으로 식별됩니다.

- VMware HPP(고성능 플러그인)

- 기본적으로 ESXi 호스트는 HPP를 사용하여 NVMe-oF 대상을 할당합니다. I/O 요청에 대한 물리적 경로를 선택할 때 HPP는 적절한 PSS(경로 선택 체계)를 적용합니다. HPP에 대한 자세한 내용은 VMware 고성능 플러그인 및 경로 선택 체계 항목을 참조하십시오. 기본 경로 선택 메커니즘을 변경하려면 경로 선택 정책 변경 항목을 참조하십시오.

기본 VMware NVMe 아키텍처 및 구성 요소

ESXi는 로컬 NVMe over PCIe 스토리지 및 공유 NVMe-oF 스토리지(예: NVMe over Fibre Channel, NVMe over RDMA(RoCE v2), NVMe over TCP)를 지원합니다.

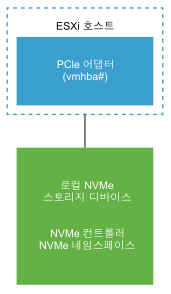

- VMware NVMe over PCIe

-

이 구성에서는

ESXi 호스트가 PCIe 스토리지 어댑터를 사용하여 하나 이상의 로컬 NVMe 스토리지 디바이스에 액세스합니다. 호스트에 어댑터를 설치한 후 호스트는 사용 가능한 NVMe 디바이스를 검색하고

vSphere Client의 스토리지 디바이스 목록에 나타납니다.

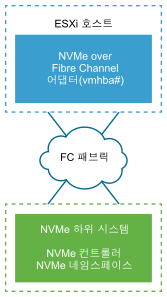

- VMware NVMe over Fibre Channel

-

이 기술은 NVMe를 파이버 채널 프로토콜에 매핑하여 호스트와 대상 스토리지 디바이스 간에 데이터와 명령을 전송할 수 있습니다. 이 전송은 NVMe를 지원하도록 업그레이드된 기존 파이버 채널 인프라를 사용할 수 있습니다.

NVMe over Fibre Channel 스토리지에 액세스하려면 ESXi 호스트에서 NVMe를 지원하는 파이버 채널 스토리지 어댑터를 설치합니다. 어댑터는 구성할 필요가 없습니다. 적절한 NVMe 하위 시스템에 자동으로 연결되고 연결할 수 있는 모든 공유 NVMe 스토리지 디바이스가 검색됩니다. 나중에 어댑터를 재구성하고 해당 컨트롤러의 연결을 끊거나 호스트 부팅 중에 사용할 수 없었던 다른 컨트롤러를 연결할 수 있습니다. 자세한 내용은 NVMe over Fabrics용 컨트롤러 추가의 내용을 참조하십시오.

- NVMe over RDMA(RoCE v2)

-

이 기술은 네트워크에 있는 두 시스템 간에 RDMA(Remote Direct Memory Access) 전송을 사용합니다. 이 전송은 운영 체제를 우회하는 기본 메모리 또는 둘 중 한 시스템의 프로세서에서 데이터 교환을 가능하게 합니다.

ESXi는 RoCE v2(RDMA over Converged Ethernet v2) 기술을 지원하며, 이를 통해 이더넷 네트워크를 통한 Remote Direct Memory Access가 가능합니다.

스토리지에 액세스하기 위해 ESXi 호스트는 호스트에 설치된 RDMA 네트워크 어댑터와 소프트웨어 NVMe over RDMA 스토리지 어댑터를 사용합니다. 스토리지 검색에 사용하려면 두 어댑터를 모두 구성해야 합니다. 자세한 내용은 ESXi에서 NVMe over RDMA(RoCE v2) 구성의 내용을 참조하십시오.

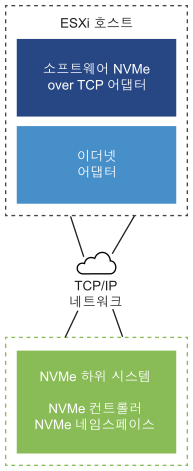

- NVMe over TCP

-

이 기술은 두 시스템 간의 이더넷 연결을 사용합니다. 스토리지에 액세스하기 위해 ESXi 호스트는 호스트에 설치된 네트워크 어댑터와 소프트웨어 NVMe over TCP 스토리지 어댑터를 사용합니다. 스토리지 검색에 사용하려면 두 어댑터를 모두 구성해야 합니다. 자세한 내용은 ESXi에서 NVMe over TCP 구성의 내용을 참조하십시오.